并购动机

推论时代的竞争压力:NVIDIA 如何应对 ASIC 挑战

NVIDIA 的营收结构目前仍高度仰赖 GPU 出货量的成长。过去市场在模型训练与推论两个阶段皆普遍依赖 NVIDIA GPU,使公司得以在 AI 浪潮下快速扩张。然而,近期市场观点部分转向,认为随着 AI 产业从高速建设期迈向成熟应用期,训练需求的增速可能会相对前期放缓。相较之下,若要支撑 AI 的大规模商业化,推论端的算力需求有机会成为下一阶段的主要成长动能。因此,GPU 的通用性与 ASIC 的效率优势将在推论市场形成直接的竞合关系,并可能影响 NVIDIA 未来的营收动能与市场份额。

以 Google TPU 为例,为了兼容各类通用运算,GPU 内部保留大量对 AI 矩阵运算非必要的电路逻辑,导致面积浪费与漏电流上升,推升单位成本;相较之下,TPU 为为推论设计的 ASIC 晶片,能在硬体层级剔除 AI 无关电路,并以脉动阵列(systolic array)针对矩阵乘法优化,降低记忆体存取需求、提升运算密度。其次,在能耗层面,电网供给吃紧使 GPU 每瓦效能的边际收益递减,散热与供电成本已占总持有成本(TCO)30% 以上,而 TPU 由于结构更简化且专用,其每瓦效能可较传统 GPU 提升 2–3 倍,在相同电力配额下更能缓解资料中心的电力瓶颈。最后,大模型训练需要数万颗 GPU 协同,NVIDIA 倚赖的 NVLink 与乙太网路在超大规模下容易出现功耗损失放大、延迟不可控等问题,Google 则为 TPU 研发 OCS(光学电路交换),以光纤在硬体层级互连,降低对传统交换机的依赖,让丛集扩张至 10 万颗晶片等级时仍能维持低延迟与高吞吐。此外,Google 在模型(Gemini)/ 框架(JAX、XLA)/ 编译器 / 网路拓扑 / 资料中心调度等层面高度自控,重质整合度高,而 Meta、Anthropic 等厂商的采购,也反映大型科技公司在推论端已开始认可非 NVIDIA 的替代解法,对 NVIDIA 的长期护城河形成潜在压力。在此背景下,NVIDIA 更需要在推论时代证明自身产品与生态的不可替代性,以延续其领先地位。

脉动阵列(Systolic Array) 脉动阵列是一种晶片设计方式,让大量的小型运算单元像流水线一样协作,快速且省电地完成矩阵运算(AI 最需要的运算)。 GPU 在原始设计上为了保留弹性,让使用性涵盖范围从原本的图形渲染、光线追踪到 AI 科学计算,因此 GPU 在设计上并非以固定化「流水线」形式的计算作为主体。反之,ASIC 在高度客制化下,可以借由脉动阵列的设计来优化计算效率,进而提升推论效率。

LPU 在推论市场的优势

| LPU (Groq) | GPU (Nvidia) | TPU (Google) | |

|---|---|---|---|

| 主要功能 | AI 推理 (特别是LLM) | 通用并行运算训练 & 推理 | AI / ML 加速训练 & 推理 |

| 核心架构 | 确定性执行核心可程式化流程 | CUDA 核心 + Tensor Core | 矩阵乘法单元(MXU) |

Groq 成立于 2016 年,创办人 Jonathan Ross 曾任 Google 晶片团队高管,亦是早期 TPU 的核心参与者之一。Groq 坚持的并非 GPU 式通用并行路线,而是一套强调低延迟、可预测执行与极致推论效率的架构,此理念与 TPU 设计思路高度同源,但与 NVIDIA 传统 GPU 取向存在明显差异。Groq 团队推出不同于 NVIDIA GPU 与 Google TPU 的晶片产品 LPU(Language Processing Unit),顾名思义针对 LLM 推论进行硬体层级优化与解构 (disaggregate)。

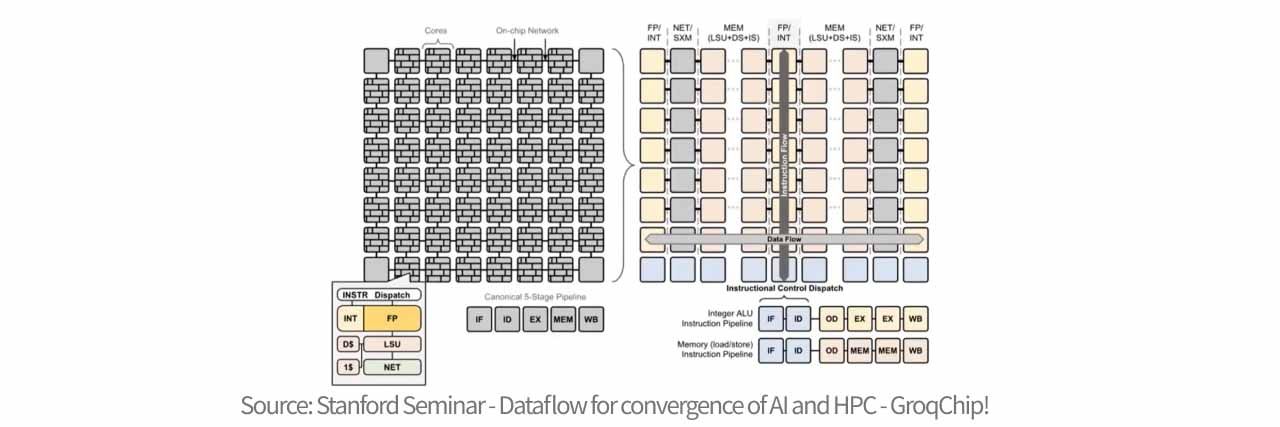

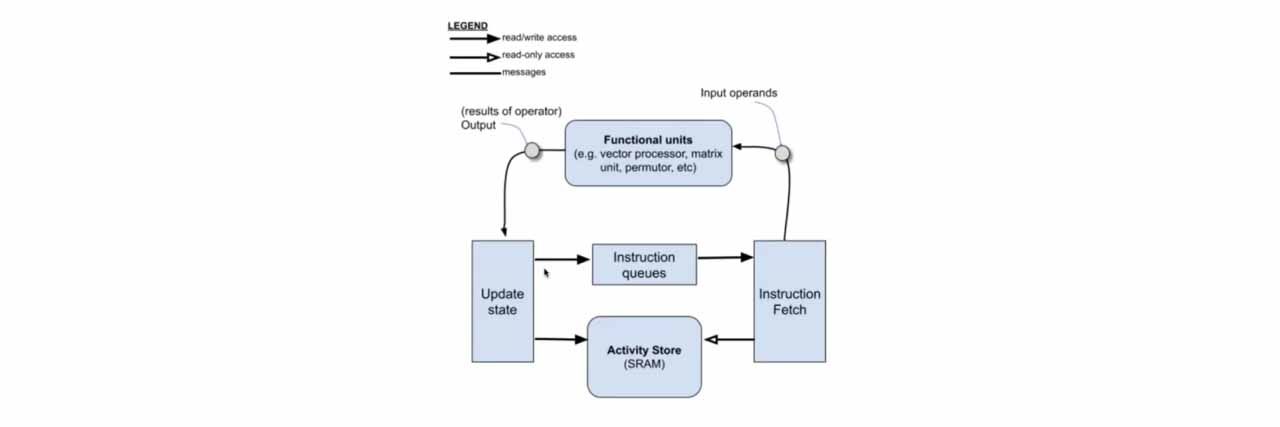

传统的晶片架构包含许多独立运作的核心 (core),每个核心都包含自己的运算、记忆体和指令控制单元,而这种结构在传输数据时,需要在核心之间反复跳转,导致路径复杂且延迟不可预测。Groq 将功能解构,它将晶片横向分为不同的功能区域,例如专门存数据的区域、专门做向量运算的区域等,而数据则在这些区域间流动,因此 LPU 可以进行更快的资料处理。LPU 的核心精神是简化硬体,并用强大的编译器安排来推进运算,抛弃了所有硬体控制逻辑,没有分枝预测、没有缓存管理、没有仲裁器 ,硬体只专注于执行指令,使绝大部分电晶体都用于算术运算。

Groq 的 LPU 之所以能在反应速度上彻底超越传统晶片,核心在于其确定性 (deterministic latency) 的架构。不同于传统 GPU 依赖复杂的硬体调度器、分支预测与多层快取(Cache),这些机制虽然通用,却会产生不可预知的延迟与硬体开销;LPU 将控制权完全移交给编译器,在执行前就精确排定了每一纳秒的数据流向与运算时机。硬体上,它舍弃了延迟性较大的外部 DRAM,采用 SRAM(静态随机存取记忆体),其硬体组成采取了高度切片化与分散式的设计,其核心由 88 个独立的记忆体切片(MEM slices)组成,每个切片拥有 8192 个地址,总容量达 230MB。这些切片被组织成四组计时群组(Quad timing groups),布局于晶片的异构功能切片之间,与 MXM(矩阵运算)和 VXM(向量运算)单元紧密耦合。在运作上,每个周期能从两个银行(Banks)同时读写一个物理流,单次读取即可产生 320Byte 的宽流数据。这种架构透过 串流寄存器(Stream Registers) 在南北向上对接完整 64 条流的频宽,实现高达 80TB/s 的极限介面频宽,让数据能以完全确定的节奏在晶片内部高速流动,流经运算单元的瞬间即完成处理,完全不需要在内存间反复搬运,消除了存取等待时间,这种设计让 LPU 消除了所有随机抖动与通讯冗余,从而实现了极致的低延迟与超高速推理。

Groq 对外宣称,其基于 LPU 的云端服务在 Llama2 或 Mistral 等模型的推论与回应速度上,显著优于以 NVIDIA AI GPU 为基础的方案,并指出其输出速度可达每秒约 500 tokens。相较之下,当时对标的 ChatGPT-3.5 公开版本约每秒 40 tokens,意味 LPU 在推论吞吐上可达 GPU 的 10 倍等级。在能耗方面,NVIDIA GPU 生成 tokens 可能需要约 10–30 焦耳,而 Groq LPU 仅约 1–3 焦耳,代表在推论速度提升的同时,单位能耗成本具数量级下降的可能。此外,NVIDIA GPU 依赖外部 HBM(高频宽记忆体),资料在晶片与记忆体间搬运容易形成 memory wall 造成延迟,且 HBM 供给紧张亦是现实瓶颈,相对地,Groq 将大量 SRAM 直接整合于晶片上,虽容量较小但可提供极高频宽(80TB/s、显著高于 HBM 8TB/s),使其在文字生成等推论工作负载上有机会达到每秒 300–500 tokens 的效率优势。

并购综效&机会

随着 AI 训练 (traning) 已进入蓬勃发展的阶段,AI 产业下一个重点领域将专注于推论 (inference) 领域,透过取得 Groq 技术,NVIDIA 可更快将 LPU 架构纳入自身 AI 生态,形成 GPU(训练)+ LPU(推论)的场景覆盖。另一方面,NVIDIA 目前在供应链端透过掌握台积电 CoWoS 封装与韩国大厂 HBM 产能,对 TPU 等竞品形成先天供给压制,反观 Groq 的 LPU 因采用的是 14 奈米制程、不需依赖 HBM,因此技术上也不须采用 CoWoS 等高阶制程,高度避开与 NVIDIA 大算力晶片的产能竞争,反而能利用较成熟产能加速出货、抢占推论市场窗口期,若 Groq 被其他潜在买家(如 Google、Meta)收编,将会对 NVIDIA 形成不小的风险。在此情况下,2025 年 12 月 24 日,NVIDIA 以 200 亿美元取得 Groq 核心 AI 推论技术的非排他性授权,在业务切割上,NVIDIA 取得 Groq 核心资产与技术授权,但 GroqCloud 云端业务不在交易范围内并维持独立运作;在人才吸纳上,Groq 创办人 Jonathan Ross、总裁 Sunny Madra 与多名核心成员加入 NVIDIA,以推进推论技术规模化落地;在公司独立性上,Groq 仍作为独立公司存在,由原 CFO Simon Edwards 出任新任 CEO 继续维持公司营运。Groq 于最新一轮的投后估值已来到 69 亿美元,后续可行性除 IPO 外,被大型云端服务商或半导体业者以并购/策略投资方式纳入生态系也是选项之一。NVIDIA 本次以技术授权方式与 Groq 达成合作,并延揽其核心管理与技术团队加入,也再度显示 NVIDIA 以推论作为下一个主战场的决心。

- NVIDIA 在训练与复杂推理上的产品优势明确,但未来的 AI 应用(如 AI 医生、自动驾驶、即时翻译)核心需求是极低延迟与可预期的回应时间,而这块市场过去 NVIDIA 的覆盖相对薄弱。整合 Groq 后,NVIDIA 等同直接补齐低延迟推论产品组合,尤其 Groq 的 LPU 在 Batch Size = 1(单人即时互动)的工作负载下能跑出极高的 token throughput 与确定性延迟。若 NVIDIA 能吸收并整合 Groq 的 SRAM 存取与资料路径设计思路,未来有机会在同一平台上同时兼具 GPU 的泛用性与 LPU 的反应速度,并彻底解决目前 HBM 记忆体带来的 Memory Wall 问题。

- Groq 于 2025 年 9 月完成第 9 轮融资,募资规模达 7.5 亿美元。NVIDIA 随即快速敲定此一策略性合作案,反映其对该交易长期价值的高度认同。Groq 所强调的「确定性(deterministic)、低延迟」推论能力,正好补足 GPU 在即时推论场景中相对较弱的结构性短板。透过纳入这项能力,NVIDIA 在面对云端业者与企业客户的采购决策时,得以降低因延迟或效率劣势而流失订单的风险,进而稳住出货量(units),并延缓 ASP 下修压力。

- 过去 NVIDIA 的 GPU 推论方案高度绑定 HBM 与 CoWoS,在推论占比快速上升的情境下,会同步放大 BOM 成本、供应链瓶颈及缺料风险。结合 Groq 架构至现有的 GPU 后,若能克服目前 LPU 高成本的困境,则 NVIDIA 在部分推论场景将有机会不再完全依赖「GPU + 大量 HBM」的重型配置,转而提供更轻量、低成本、低延迟与能效为优先的推论方案,这等同于在推论端降低单位成本与交付风险,并使产品组合更贴近推论时代的主流需求。

并购风险

财务风险

NVIDIA 本次交易对价为 200 亿美元,全现金支付。从资产负债表观察,截至 3Q25 公司帐上现金及约当现金约 606 亿美元,即使一次性支付 200 亿美元,仍可保有逾 400 亿美元的现金水位,足以支应日常营运周转,同时维持对研发投入、股票回购与后续中型并购的财务弹性。

以现金流量体质做观察,3Q25 NVIDIA 单季自由现金流达 221 亿美元,营运现金流更高达 238 亿美元,等同于公司仅需约一季的营运现金创造能力,即可覆盖整笔交易对价,显示本案在资金来源上不构成压力。

从杠杆与偿债能力角度,NVIDIA 长期 D/E 约落在 0.1、财务杠杆保守,利息保障倍数亦高达 400 倍以上,显示公司具备极强的偿债与利息负担承受能力。全案以现金支付也显示 NVIDIA 对于自身财务健康度的高度信心。综合以上,本次交易的重心或许不在于对收购方是否带来财务风险,而在于以投资回报的角度而言,此次的交易案是否能在合理的时间内转化为可量化的营收贡献,或快速提升自身产品的竞争力,稳住市场渗透率。

技术风险

- Groq 的 TSP/LPU 架构能否无缝纳入 NVIDIA 既有推论软体栈与开发者生态仍具不确定性。若无法被 CUDA 等体系完整吸收,那 Groq 对 NVIDIA 的定位将更偏向技术备援工具,而非可规模化产品。

- Groq 纳入后,在低延迟推论可能直接与 NVIDIA 既有 GPU 推论方案形成内部竞争,若公司无法清楚划分产品定位与客群边界,可能出现产品内部竞争问题。

- 本次交易为非排他性,意味 Groq 技术理论上仍可能授权给其他对手或云端客户自建方案,NVIDIA 不一定是唯一、甚至不一定是最大受益者。

可行性分析

这类大规模并购交易往往容易引发监管部门介入与反垄断审查。然而,本次 NVIDIA 采取的是「类并购」结构:交易核心并非将 Groq 完整并入公司体系,而是取得其关键推论技术的授权,并同步吸收 Groq 的核心团队;同时,Groq 仍将维持独立营运,其 GroqCloud 云端业务亦不纳入交易范围,将持续独立运作。

相较于过去 NVIDIA 尝试并购 ARM 时,因涉及全球生态系关键 IP 而引发高度监管阻力,本次合作的授权形式更进一步采取「非独家」安排,不仅降低外界对市场集中化的疑虑,也保留 Groq 作为独立竞争者与技术供应者的空间,进而在策略布局与监管风险间取得更佳平衡。

Nvidia 代表性收购案

| 标的公司 | 收购金额 (美元) | 前后轮估值比值 | 收购主因 |

|---|---|---|---|

| Groq (2025) | 200 亿 | ~ 190 % | 拓展推论领域竞争力 |

| Mellanox Technologies (2020) | 70 亿 | ~ 17% | NVIDIA 史上最大正式完成的并购,奠定资料中心与网路技术基础 |

| Run:ai (2024) | 7 亿 | ~ 80% | 提供 GPU 池化与虚拟化技术,优化 AI 算力分配 |

| PortalPlayer (2006) | 3.57 亿 | ~ 19% | 强化行动媒体播放器与手持装置晶片技术 |

| (失败) ARM 收购案 (2020-2022) | 400 亿 | NA | 建立 AI 运算生态系 |

市场影响

主宰推论市场 ASIC 晶片受到威胁

LPU(语言处理单元)的技术核心在于其固定的设计架构,这与传统 GPU 依赖硬体排程来处理不确定性的做法完全不同。LPU 的设计灵感源自数据流 (Dataflow) 概念,其内部完全取消了缓存 (Caches)、分枝预测与仲裁器 (Arbiters)。这种「抛弃复杂硬体控制逻辑」的作法,让指令控制开销降至 3% 以下,将绝大部分晶片面积留给了负责矩阵运算的 MXM 单元。

Groq 的编译器在编译阶段就精确排程了数据在每一周期 (cycle) 的流向,这使得 LPU 能提供 100% 可预测且不随时间抖动的低延迟表现。对于需要长文本生成与高频连续推理的 AI 应用,LPU 透过 230MB 的片上 SRAM 提供高达 80 TB/s 的记忆体频宽,远超依赖外部记忆体的传统架构,从而实现了每秒上千个 Token 的极致生成速度。若未来 Nvidia 将此一技术融入自家的 GPU,或是另外设计专门应用于推论的晶片,Nvidia 将能凭再训练市场上既有的优势及市占率,也将自家推论晶片打入市场,提升对 Broadcom (AVGO) 等传统 ASIC 晶片商的竞争力。

LPU 影响 CoWos 及 HBM 的需求

LPU 采用的记忆体架构并未使用 HBM,因此现阶段也不需要使用 CoWoS 先进封装技术。传统 GPU 与 AI ASIC 为了追求吞吐量,必须依赖昂贵且产能受限的 HBM 与 2.5D 封装技术,然而 LPU 选择将 230MB 的 SRAM 直接整合在晶片核心内部。这种设计对供应链的影响在于,LPU 证明了透过优化数据流路径与软体排程,可以在不依赖 HBM 的情况下达成更优异的推论效能。这对于目前的封装巨头来说,虽然短期内需求依然强劲,但长期而言,LPU 引导的 SRAM 使用架构可能分散对 CoWoS 产能的绝对依赖。

短期而言,这并非意味着 HBM 在市场上的地位会遭到取代。HBM 在多数的使用场景中仍具备强大的优势,硬体规格来看单颗 GPU 的 HBM 容量是 LPU SRAM 的400 到 900 倍;而造价方面 SRAM 的成本也远高于 HBM。若 NVIDIA 能在整体制程技术上有更进一步的突破,或许能将进一步提升 LPU 的适用场景。

LPU 的终端应用市场

LPU 的商业价值建立在其简化硬体所带来的低延迟。LPU 晶片内部与晶片之间不依赖传统的异步网络包交换,而是透过全域时间同步机制,由编译器直接排程实体链路。这种技术让 LPU 系统能像一个「巨型单一晶片」般运作,消除了数据传输中的延迟抖动(Jitter)。

在落地应用上,这种技术优势直接转化为即时性。在语音 AI 或虚拟老师等互动场景中,LPU 能提供极致的反应速度,解决了传统架构产生的数位尴尬。而在对延迟极度敏感的金融高频交易 (HFT),LPU 的确定性特性保证了推理时间的绝对稳定,不会因突发的数据拥塞而产生延迟变动。虽然其 SRAM 容量限制了单机承载的模型大小,但透过 Dragonfly 拓扑网路扩展技术,LPU 系统正逐步在需要「毫秒级反应」的专业领域中,建立起与 GPU 截然不同的市场版图。

评论

针对 Nvidia 对 Groq 取得技术授权及延揽人才,在短期内可能并未有太大的综效,原因在于目前 LPU 仍存在极大的缺点,例如其所使用的 SRAM 价格高昂,且记忆题容量极小,几乎只有 HBM 的千分之一,因此在实际运用上仍有其限制性。

然 LPU 凭借其快速的计算能力及节电效能,仍具有潜在技术优势;另一方面,LPU 的设计本质上是简化硬体并设计一套复杂的编译器来负责运算,因此 Groq 的编译器也具有潜在价值。除了技术的取得,人才延揽已为 AI 大战的常态,加上 Nvidia 拥有庞大的自由现金流,因此以 200 亿收购 Groq 并不会对其造成太大的负担。因此针对 Nvidia 对 Groq 技术取得,需追踪后续其将此技术结合至既有产品及业务的综效。